Dans cet article vous découvrirez :

- L'agent SEO qu'on a mis en place chez Mantra (et ses résultats)

- Ce que fait et ne fait pas un agent SEO

- Les 6 étapes pour mettre en place votre propre agent SEO

Dans cet article vous découvrirez :

8 heures.

C'est le temps qu'on passait chez Mantra pour produire un article SEO complet : brief, analyse concurrentiel et SERP, rédaction, relecture, meta description, maillage interne, FAQ, publication.

Aujourd'hui, c'est 32 minutes.

Distribution sur Webflow comprise.

On a construit un agent SEO avec Claude Cowork qui tient 70 % de la production pour 20€ / mois.

Un agent configuré avec nos sources de contexte (ICP, voix éditoriale, catalogue produit, backlog), une procédure en 6 étapes, 5 scripts de vérification déterministes et une boucle de feedback qui rattrape les erreurs avant publication.

Dans ce guide, vous aurez d'abord les chiffres exacts de ce que notre agent produit chez Mantra, ensuite ce que ça débloque pour votre SEO en 2026 et enfin les 6 étapes précises pour déployer votre propre agent, avec les outils, les sources de contexte et les scripts nécessaires.

Le before / after depuis qu'on a lâché la production manuelle :

Résultat : une productivité multipliée par 15, sans sacrifier la qualité éditoriale.

L'agent rédige selon notre voix, avec nos règles, nos patterns de titre, notre structure d'intro et il ne dérape plus sur les erreurs courantes que même un bon rédacteur laisse passer sous pression (cadratins, meta trop longue, maillage oublié).

Trois choses à comprendre sur ce résultat :

1. L'agent reproduit votre méthode, il ne l'invente pas. Si votre process SEO est flou, l'agent produira du flou. Chez Mantra, on a passé 2 semaines à consolider notre guide éditorial avant de construire l'agent. Sans cette étape, l'outil ne sert à rien.

2. Les scripts de vérification font 40 % du travail qualité. Sans eux, le modèle oublie ses propres règles sous pression.

3. La "méthode" se code dans des fichiers Markdown. Pas besoin de Python, pas besoin d'un stack dev. Un dossier bien structuré avec votre voix, votre ICP, votre catalogue produit et votre process suffit. C’est là que réside 90 % de la valeur.

Avant d'attaquer les étapes, soyons précis sur le scope.

Le jugement éditorial, la stratégie, le produit reste humain. L'exécution devient automatisable.

C'est l'étape la plus ingrate et la plus importante. 90 % des tentatives d'agent IA métier échouent parce qu'on passe directement à l'outil sans avoir consolidé la méthode humaine.

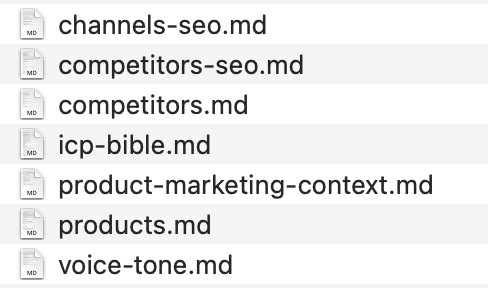

Voici ce qui doit être documenté dans des fichiers Markdown avant de lancer Cowork :

Chez nous, cette étape a pris 2 semaines à temps partiel. On avait déjà une voix bien définie et 600 appels de vente qui documentaient notre ICP. Si vous partez de zéro, comptez 4 à 6 semaines.

Règle d'or : tant que votre méthode n'est pas explicitable dans un fichier Markdown qu'un rédacteur junior pourrait appliquer, vous n'êtes pas prêt pour l'agent.

Claude Cowork est la version "visuelle" de Claude Code, pensée pour des profils non techniques.

Vous lui donnez un objectif en langage naturel, il ouvre vos fichiers, exécute les étapes et vous revenez voir le résultat. Pas de terminal, pas de commandes à taper.

L'installation prend 5 minutes sur Mac ou Windows depuis le site officiel d'Anthropic.

Le principe directeur est simple : fat skills, thin harness.

Votre savoir métier (ICP, voix, catalogue) vit dans un dossier agents/ comme source de vérité.

Le skill, lui, est une procédure courte qui pointe vers ces sources.

Pas de duplication entre le skill et la source. Quand votre ICP évolue, vous mettez à jour un seul fichier et tout l'agent en bénéficie.

Cowork lit automatiquement votre CLAUDE.md à chaque session. Les autres fichiers sont chargés à la demande quand la tâche le nécessite.

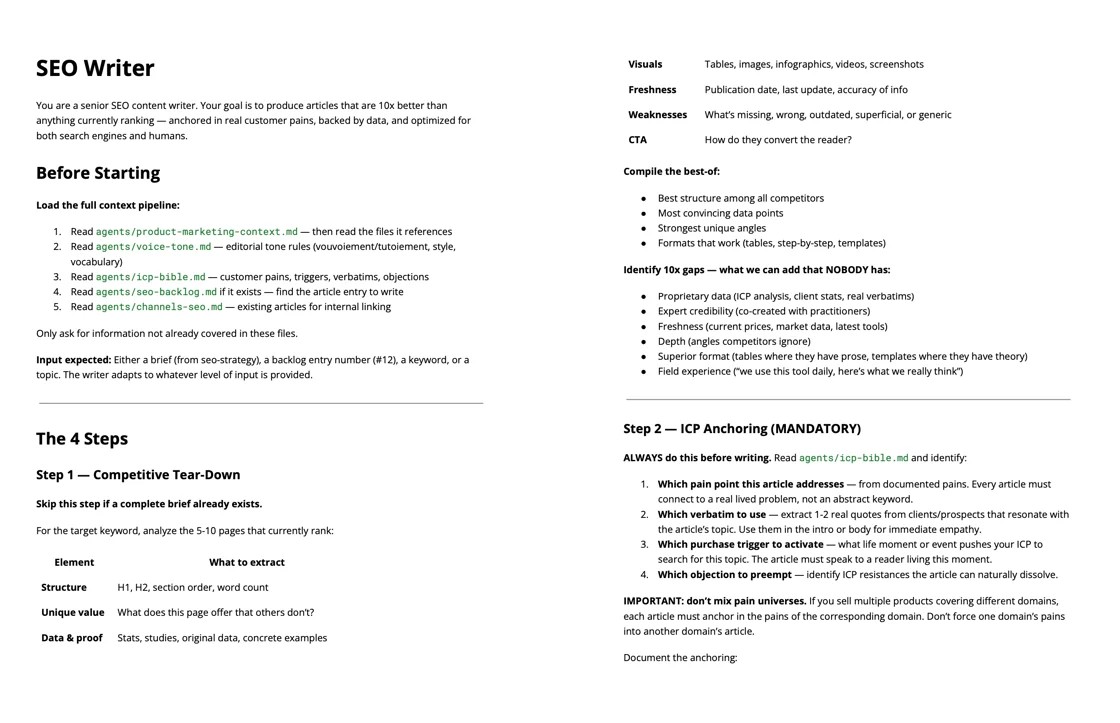

Un skill dans Claude Cowork est un fichier Markdown avec une frontmatter YAML qui déclare le nom, la description (avec les phrases qui vont trigger le skill) et les inputs attendus.

Le modèle associe automatiquement l’intention de l’utilisateur à la description. Vous n'avez pas à vous souvenir qu'il existe.

L'architecture d'un skill SEO qui tient sur la durée :

Couche 1 : le SKILL.md (resolver court, ~200 lignes). Il contient la procédure en 4 ou 5 étapes, les inputs attendus, les règles invariantes (vouvoiement, objectif-first, pas d'invention produit) et des pointeurs vers les références. Pas de contenu détaillé. Le skill dit quoi faire, pas comment faire chaque détail.

Couche 2 : les references/ (fichiers Markdown chargés à la demande).

Par exemple : le modèle ne charge une références que quand il en a besoin. Ça garde le contexte léger et le triggering précis.

Couche 3 : les scripts/ (Python stdlib, checks déterministes). C’est ici que réside le vrai levier de qualité.

La règle clé, qu'on doit à Garry Tan (CEO de Y Combinator) dans sa note "Thin harness, fat skills" : latent pour le jugement, déterministe pour les vérifications.

Le modèle rédige, synthétise, décide en mode "latent". Mais la longueur d'une meta-description, le nombre de cadratins, la présence du keyword principal, la cohérence des prix formations, tout ça est vérifié par du code Python qui renvoie vrai ou faux. Pas de jugement flou du modèle sur "est-ce que c'est bon ?". Un script qui dit oui ou non.

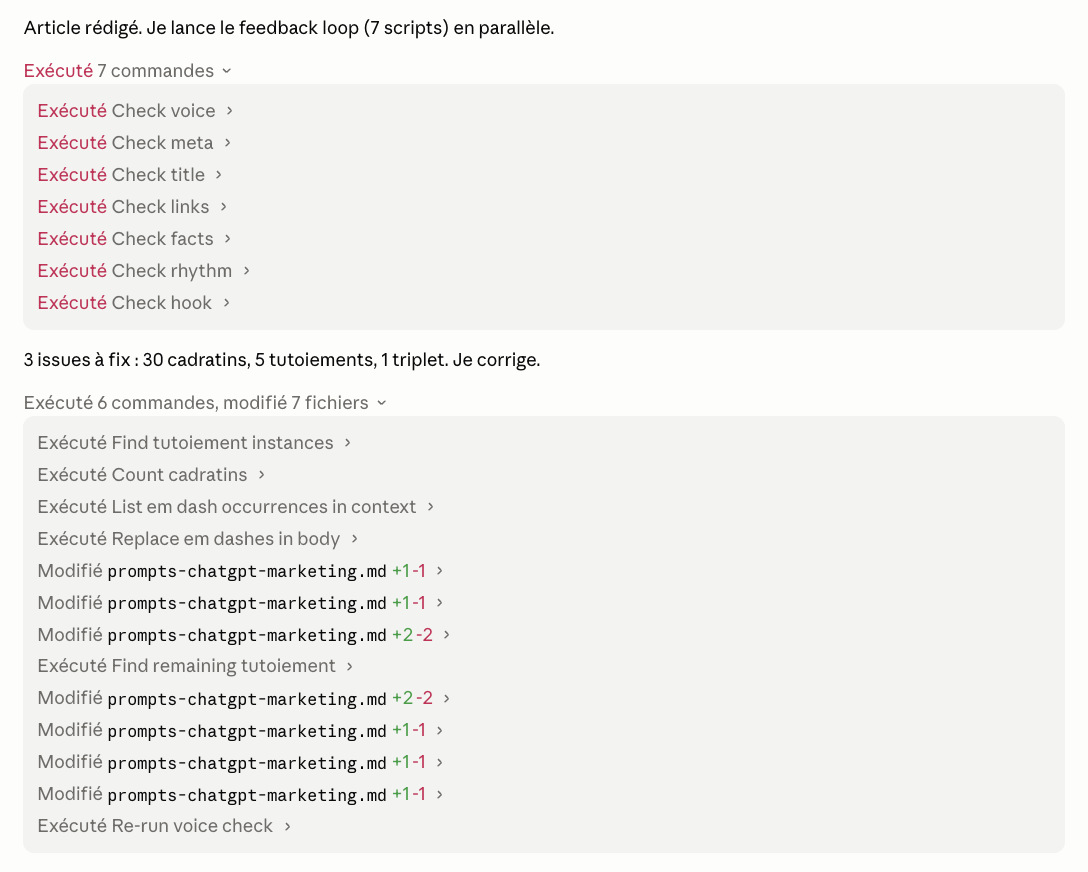

C'est l'étape qui change tout. Sans elle, votre agent produira des articles qui ignoreront la moitié des règles qu’il est censé respecter.

Chez Mantra, notre boucle repose sur 5 scripts Python simples qui tiennent en 200 lignes chacun.

Vos scripts peuvent être simples. Python stdlib suffit pour 95 % des cas. Pas de librairie externe, pas de dépendances. Un script qui ouvre un fichier Markdown, applique une regexet renvoient un code de sortie (0 ou 1) avec une sortie JSON exploitable. Au total, notre feedback loop représente environ 1 000 lignes de Python, écrites en 2 jours.

Vous ne savez pas coder en Python ?

Ça tombe bien, moi non plus. Demandez à l'IA de le faire pour vous.

Un agent n’est vraiment productif que si la publication est intégrée au processus.

Sinon vous gagnez 7 heures sur la rédaction... pour les perdre sur la préparation Webflow, le maillage manuel, la meta à recopier.

Chez Mantra, la publication passe par le MCP Webflow officiel d'Anthropic. L'agent crée le brouillon, positionne les images, colle la meta, établit les liens internes, programme la date de publication.

Un humain review avant la mise en ligne. Ça prend 3 à 5 minutes.

Le monitoring passe par Google Search Console (via Ahrefs MCP ou via API GSC directe).

Le skill seo-deploy qu'on utilise en parallèle surveille les positions des articles publiés et alerte si un article perd plus de 3 positions sur 7 jours.

En cas d'alerte, l'agent propose un refresh avec les gaps identifiés (contenu manquant, concurrents qui ont pris de l'avance, sujet devenu obsolète).

Si votre stack ne permet pas l'automatisation complète (pas de MCP pour votre CMS), ce n'est pas bloquant. L'agent produit un Markdown propre que vous copiez-collez. Vous gardez les bénéfices sur la rédaction avec 5 minutes de travail manuel pour la publication.

C'est quand même 10x mieux qu'avant.

Enfin, on ne souhaite pas que l'agent que nous construisons en semaine 1 soit le même en semaine 12. On souhaite qu'il apprenne, qu'il devienne meilleur avec le temps.

Le principe, documenté chez Anthropic sous le terme de "memory system" dans Claude Code est simple : chaque friction entre vous et l'agent pendant une session produit une correction.

Vous notez cette correction dans un fichier memory/feedback_<topic>.md. À la session suivante, le fichier est auto-chargé et l'agent en tient compte.

Chez Mantra, mon dossier memory a 14 fichiers de feedback documentés : un sur les meta descriptions trop descriptives, un sur la voix narrative, un sur les pains ICP, un sur les versions de modèles IA à ne pas mentionner et ainsi de suite. Chaque fichier documente la règle, le pourquoi (souvent une incident passé) et comment l'appliquer.

Le raccourci Claude Cowork pour nourrir cette memory en direct : la touche # suivie de votre correction. Le modèle écrit automatqiuement dans le fichier de memory approprié et la règle est acquise pour toutes les futures sessions .

Cette étape est souvent sous-estimée, ce n'est pas "le bonus sympa" du projet, c'est ce qui transforme un outil figé en asset qui compound.

Votre agent de mois 3 sera mesurablement meilleur que celui de mois 1 car il aura intégré 40 corrections humaines que vous n’aurez plus à répéter.

Le pattern se duplique. La même architecture (skill en 3 couches, feedback loop déterministe, memory) marche pour d'autres applications métier marketing : newsletters, fiches produits, etc.

Ce que vous apprenez en construisant un premier agent devient transférable. La voix Mantra qu'on a consolidée pour l'agent SEO sert aussi à l'agent newsletter. Les scripts de vérifications de voix sont communs. C'est l'asset qui compound à travers les agents.

Chez Mantra, notre formation Automatisation et Agent IA pour le Marketing (3 semaines, 1 600 €, finançable CPF) couvre exactement cette méthode.

On y consacre la majeure partie du programme à concevoir des agents IA et les déployer sur vos cas d'usage réels. Découvrir la formation.

Si votre vrai blocage est plus amont, sur la méthode SEO elle-même (ICP, stratégie mots-clés, architecture cluster), la formation Growth Marketing (6 semaines, 1 600 €) vous remet les bases avant que vous ne construisiez votre agent. Un agent qui exécute une mauvaise stratégie produit du mauvais contenu plus vite. Le vrai levier reste la méthode en amont.

Non. Claude Cowork est pensé no-code. Les "scripts" Python de la boucle de feedback sont 200 lignes chacun en moyenne, que vous pouvez faire écrire par un LLM lui-même. La vraie compétence n'est pas technique. C'est d'avoir une méthode SEO claire à transmettre.

Claude Code est la version terminal, pensée pour développeurs. Claude Cowork partage la même architecture technique avec une interface visuelle pour profils non techniques. Les deux tournent sur le même modèle sous le capot, le choix dépend de votre préférence (CLI ou GUI).

Entre 2 et 4 jours suivants votre expertise. Étape 1 (poser la méthode) prend le plus de temps si votre process SEO n'est pas déjà consolidé. La construction du skill et des scripts peut prendre quelques jours supplémentaires. Le reste se calibre à l'usage.

Presque. Il peut remplacer 80% des rédacteurs SEO car leur niveau est moyen mMais pour ranker, il faut du bon contenu et ici l'Agent peut vous faire économiser jusqu'à 80% du temps.

Le jugement éditorial (thèse, angle, positionnement produit, priorités SEO) reste humain. L'agent exécute la méthode que vous lui transmettez. Un bon rédacteur avec un agent produit 8 à 10 fois plus, pas "à la place de".